Geoffrey Hinton:後悔創造神的 AI 教父

介紹 AI 教父 Geoffrey Hinton。他堅持了 30 年沒人相信的「深度學習」,直到這股力量在 2012 年接管了世界。現在,他卻帶著諾貝爾獎的殊榮,成為了最擔憂自己造物的人。

WRITTEN BY

- Name

- Harry Chang

繼 McCarthy 的邏輯世界之後,我們來看看 Geoffrey Hinton 的感性反擊。

如果說 McCarthy 將智慧視為精密的邏輯推演 (Top-down),那麼 Hinton 則堅信智慧是神經連結的湧現 (Bottom-up)。他花了 30 年的時間,在學術寒冬中守護著「神經網路」這個被嘲笑的技術,直到它接管了整個世界。

- 為什麼你需要認識 Geoffrey Hinton?

- 核心哲學:向大腦學習 (Biomimicry)

- 經典語錄 (Classic Quotes)

- 影響力與案例

- 實用建議

- 我的反思

- 參考資料 (References)

為什麼你需要認識 Geoffrey Hinton?

你可能每天都在用 ChatGPT、用 Midjourney,但很少人知道,這些神奇的魔法背後,都源自於 Hinton 在 1986 年堅持的一個簡單信念:「我想知道大腦是怎麼運作的。」

他的故事對我們這一代人有兩個重要的啟示:/

- 如何面對孤獨的真理:當全世界都說你錯了的時候,你該如何堅持?

- 如何面對造物的責任:當你創造的東西可能毀滅世界時,你該如何選擇?

他最近辭去 Google 的工作,只為了能自由地警告世人 AI 的風險,這份勇氣與他的學術成就一樣令人動容。

核心哲學:向大腦學習 (Biomimicry)

Hinton 的哲學非常樸素:既然人腦是宇宙中唯一已知的智慧實體,那麼 AI 就應該模仿人腦。

他反對寫死規則(Rule-based),主張讓機器「自己學」。這就是深度學習 (Deep Learning) 的精髓:不要告訴電腦貓長什麼樣,給它看一千萬張貓的照片,讓神經網路自己去「悟」出貓的特徵。

經典語錄 (Classic Quotes)

"I have always been convinced that the only way to get artificial intelligence to work is to do the computation in a way similar to the human brain."

「我一直深信,要讓人工智慧運作的唯一方法,就是模仿人腦的運算方式。」

(解讀:這句話支撐了他 30 年的冷板凳歲月。)

"I console myself with the normal excuse: If I hadn't done it, somebody else would have."

「我用一個普通的藉口來安慰自己:『如果我沒做,別人也會做。』」

(解讀:這是在他獲得諾貝爾獎後,對 AI 風險最深沉的無奈與懺悔。)

影響力與案例

1. 反向傳播 (Backpropagation)

1986 年,他定義了「反向傳播算法」。簡單說,這是一套數學機制,讓神經網路知道「我剛剛猜錯了,錯在哪裡,該怎麼微調參數」。這是現代所有 AI 模型(包括 GPT)的心臟。

2. AlexNet 時刻 (2012)

2012 年,他和學生推出的 AlexNet 在 ImageNet 大賽中以碾壓性的優勢奪冠,正式宣告了深度學習時代的來臨。

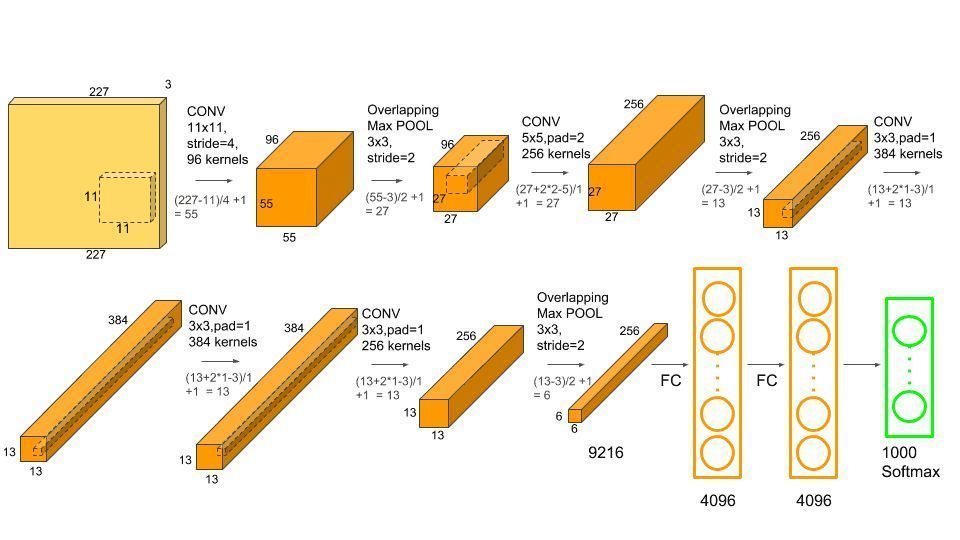

AlexNet Architecture (Source: LearnOpenCV)

這張圖展示了 AI 如何像人眼一樣「看」世界:

- 輸入層 (Input):接收圖片。

- 卷積層 (Conv):提取線條與形狀特徵。

- 全連接層 (FC):綜合判斷並輸出結果。

- Dropout:Hinton 發明的技巧,隨機關閉一半神經元,強迫 AI 不要死記硬背。

補充:LeNet-5 與 AlexNet 的差異

許多人會問,LeNet (1998) 與後來讓深度學習爆紅的 AlexNet (2012) 差在哪裡? 其實結構邏輯是一模一樣的。AlexNet 只是把 LeNet 變得「更深、更寬、更強」:

- 深度:LeNet 只有 5 層,AlexNet 有 8 層。

- 激活函數:LeNet 使用 Sigmoid/Tanh (容易梯度消失),AlexNet 改用 ReLU (計算快、不飽和),這是訓練深層網路的關鍵。

- 防止過擬合:AlexNet 引入了 Dropout。

- 運算力:LeNet 用 CPU 訓練,AlexNet 是史上第一個大規模使用 GPU 訓練的模型。

LeNet 就像是概念車,而 AlexNet 則是真正量產並跑上賽道的 F1 賽車。

2. 推動 PyTorch 與 LLaMA

作為 Meta 的 AI 掌舵者,他堅持兩大貢獻:

- PyTorch:現在全世界研究者最愛用的深度學習框架。

- LLaMA:在 OpenAI 選擇閉源 (Close AI) 時,他力排眾議將強大的 LLaMA 模型開源,讓全世界的開發者都能在自己的電腦上跑 AI,打破了巨頭的壟斷。

實用建議

步驟 1:擁抱「反直覺」

Hinton 曾說,最棒的靈感往往來自對直覺的信任,而非數據的推導。

Action: 當數據告訴你 A 是對的,但你的直覺告訴你 B 才有未來時,試著給 B 一點資源去驗證。偉大的創新往往在數據還沒出現前就發生了。

步驟 2:容忍「錯誤」

神經網路學習的核心就是 Error Correction(錯誤修正)。

Action: 在學習新技能時,不要追求「一次做對」。刻意去犯錯,然後觀察「誤差」在哪裡,再修正回來。這才是大腦最自然的學習方式。

步驟 3:保持「警覺」

Hinton 在巔峰時選擇吹哨。

Action: 在你的職涯中,除了追求績效,也要保留一份對「後果」的思考。不管你在做什麼產品,問自己:「如果這個東西成功了,世界會變得更好還是更壞?」

我的反思

Hinton 是一個悲劇英雄。他用一生的時間追逐光明,卻在終點發現自己可能釋放了黑暗。他的故事告訴我們,科技沒有善惡,但創造科技的人必須有良知。

參考資料 (References)

相關影片

這是 Hinton 在獲得諾貝爾獎後的訪談,他詳細講述了為什麼他對現在的 AI 感到恐懼。

書籍/論文推薦

- Genius Makers (深度學習的黎明): 這本書講述了 AI 如何從被嘲笑的邊緣學科變成世界主宰的歷史,Hinton 是書中的靈魂人物。

- The Deep Learning Revolution: 由另一位 AI 巨頭 Terrence Sejnowski 撰寫,以第一人稱視角回顧了他與 Hinton 等人如何推動這場革命。

參考來源

- Geoffrey Hinton's Home Page: 多倫多大學官方頁面。

- The Nobel Prize in Physics 2024: 諾貝爾獎官方介紹。